Skrivet av CreativeX:

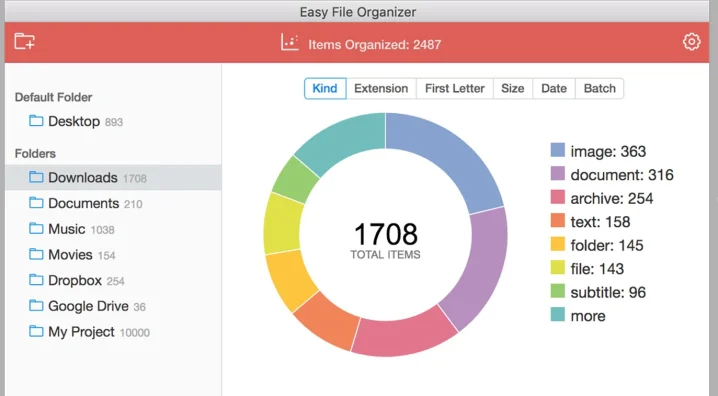

Något "liknande" är jag ute efter. Men jag är inte sugen på att betala 399:- för detta eller vad det nu är.

<Uppladdad bildlänk>

Vad är det egentligen du vill göra? När jag läser mellan raderna så verkar det mer ut som att du vill organisera och kategorisera innehållet. Det där programmet ser mer ut att tala om mängden av olika filtyper. Det första du behöver göra är att hitta vad du letar efter för att sedan sortera ut vad och hur du vill ha kvar informationen och att hitta i informationen.

I din frågeställning låter det mer som att du letar efter ett program som agerar lite mer "Klicka här och få ett magiskt resultat."

Du nämner även att det känns jobbigt med saker som tar tid.

Jag tror att problemet för dig egentligen är att överblicka problemet än att lösa problemet och om du inte har erfarenhet av problemet så känns svårt och ogreppbart.

Det som tar tid är att skyffla om filer mellan diskar och att lägga dom i grupper som är relevanta för dig. Det här tar tid, betydligt längre tid än det tar att kopiera filer från en disk till en annan just därför att det är svårt att skapa en struktur om man inte redan vet vad man vill ha. Tricket här är att man redan när man skapar filer har en tillräckligt hård struktur och som är oberoende av OS / programvara för att lätt kunna migrera informationen till nästa dator.

Jag själv har delat upp informationen så här på datorn:

Operativsystem

Hemkatalogen

Varm data

Kall data

Operativsystemet och hemkatalogen säger sig själva antar jag. Varm data är sådant som ofta ändras eller är aktuell. Kall data är sådant som sällan eller aldrig ändras, som exempelvis avbilder, backupper, ISO, mp3, mp4 etc eller filer som inte behöver speciellt hög hastighet.

Lite naturligt så hamnar varm data på SSD:er och kall data på hårddiskar, men det är inte ett måste.

Genom att bygga en struktur här så kan du lätt skapa en hierarki och bestämma hur det ska se ut och att skapa en plan för hur det ser ut.

Jag tror att det finns tre typer av saker du behöver göra:

Organisera och gruppera efter typ / storlek, användningsområde och annan parameter

Städa onödiga dubbletter

Skapa en hierarki för att lätt kunna hantera en logik och backupplan

Det finns några program som gör dessa saker utmärkt anser jag:

find - Hittar kataloger / filer baserat på namn, storlek, datum etc.

sha256sum - Jämför och hittar filer som har exakt samma innehåll

rsync - kopierar filer efter vissa förutsättningar och kan både kopiera och ta bort filer utifrån vad som finns och inte finns.

wc - Räknar text i olika former. Perfekt för att räkna resultat från andra programs utdata.

sort - Sorterar andra programs output i ordningsföljd

grep - Greppar och markerar ut rader som innehåller olika ord för att lätt kunna hitta information från större mängd output.

mc - midnight commander, en klon av norton commander som hanterar kataloger mot varandra.

tar - Utmärkt program för att komprimera kataloger för att göra dom mindre eller för att arkivera som backupper

find

Kombinerar du find och wc kan du lätt räkna antalet filer av en viss typ:

find . -type f -iname *.mp3 | wc -l

Vilket då ger ett svar:

vilket är antalet filer som uppfyller namnet.

sha256sum

Kombinerar du sha256sum och sort kan du lätt sortera filer efter deras checksumma:

sha256sum filnamn1.ext filnamn2.ext [...] | sort

Har du många filer kan du skriva resultatet till en fil:

sha256sum filnamn1.ext filnamn2.ext [...] | sort > sha256sum-resultat.txt

rsync

rsync jämför kataloger och kopierar och / eller tar bort filer efter vad man väljer:

rsync -abciv --progress suffix="~1" ./startkatalog/ ./slutkatalog/

Detta exempel kopierar innehållet i startkatalog till slutkatalog och skapar nya filer, uppdaterar redan existerande filers parametrar, skapar backupper på filer som ändrats (-b och --suffix) och jämför filer exakt utifrån deras exakta innehåll (-c).

rsync -abciv --progress suffix="~1" --delete ./startkatalog ./slutkatalog/

Detta exempel kopierar katalogen startkatalog in i slutkatalog och skapar nya filer, uppdaterar redan existerande filers parametrar, skapar backupper på filer som ändrats (-b och --suffix) och jämför filer exakt utifrån deras exakta innehåll (-c). Filer som finns i destinationens startkatalog kommer att tas bort om dom inte finns i ursprungskatalogen.

Med rsync så kan du lägga till parametern --dry-run. Då får du ett resultat som visar vad som skulle ha hänt om du kört på riktigt. Utan att ändra något på disken.

rsync är extremt bra när man ska sammanfoga kataloger som har ganska lika innehåll och man kan exempelvis kopiera ihop flera kataloger till en och garanterat få dom unika filerna från respektive katalog och slipper onödiga dubbletter av filer med samma namn. Om två filer med samma namn på samma plats är lika i innehåll så görs ingen kopia. Kopian görs bara om innehållet är olika, därav parametern -c som jämför filer exakt på dess innehåll.

Ett exempel på en backup här är att köra en rsync av sin hemkatalog till en backupkatalog och sedan omedelbart komprimera ner sin backupkatalog till en .tar.gz fil. Med det resultatet har man en uppackad backup och en komprimerad backup. Efter ett viss antal backup-filer så tar man bort den äldsta. Med parametern --delete tillagt till rsync så kan man avgöra om filer från backupkatalogen som inte finns i hemkatalogen ska tas bort i backupkatalogen. Genom att genast komprimera backupkatalogen så får man flera versioner av backuppen att gå tillbaka till. Ett bra filnamn här är att använda logiken YYYY-MM-DD--TT:MM.tar.gz vilket ger exakt när man komprimerade backupkatalogen och i princip 100% garanti att filnamnet blir unikt.

Eftersom rsync bara ändrar filer som har ändrats, lagts till eller tagits bort så går det fort att ändra. När du har koll på strukturen så behöver man inte använda -c för att jämföra filer utan bara utgå från storlek och tid. Här finns val som --size-only, --ignore-times, --update, --append, --append-verify som på olika sätt avgör om en fil ska uppdateras eller inte. Självklart använder man inte heller -b när man gör en backup av det här slaget eftersom logiken är att ens backupkatalog hela tiden ska spegla den katalog man gör backup av.

rsync skulle jag säga är ett av dom starkaste programmen som finns när man ska jämföra filer. Själv körde jag en jämförelse mot några gamla kataloger under fredag natt och fick ett resultat som minskade från 6.1 TB till drygt 600GB. Nu har jag en struktur som är jämförbar med min uppsättning och kan gå igenom en katalog istället för sju stycken. Mycket av innehållet finns redan på rätt ställe så 90% slängs antagligen. Vilket innebär att dom sju ursprungliga katalogerna efteråt kan kastas rakt av och därefter kan jag kasta alla .tar.gz av katalogerna. Vilket innebär 2 uppsättningar tar.gz-filer och dom uppackade katalogerna. vilket tillsammans ger omkring 20TB ledigt utrymme.

Tricket här är att datorn har kunnat pyssla under natten och kunnat göra det jobbiga "bulk-görat" under natten. Där jag sedan bara kontrollera en 1/7 av innehållet. Skulle någon av filerna ha samma namn men olika innehåll / storlek så har jag fått dubbletter av dom filerna och kan lätt upptäcka om en fil är skadad eller har en orimlig storlek. Eller är två olika filer med olika innehåll.

Sedan jämför jag filer med sha256sum och ser om filer har samma innehåll med olika namn, vilket gör att onödigt många kopior kan sorteras bort.